Die Technologie hinter Deepfakes

Schöpfungsprozess

Deepfakes werden hauptsächlich mithilfe von Deep-Learning-Algorithmen generiert, wobei Generative Adversarial Networks (GANs) eine herausragende Technik darstellen. GANs bestehen aus zwei neuronalen Netzen: einem Generator und einem Diskriminator.

- Generator: Dieses Netzwerk erstellt synthetische Daten wie gefälschte Bilder oder Videos und versucht, echte Daten nachzuahmen.

- Diskriminator: Der Diskriminator bewertet die Authentizität der generierten Daten und unterscheidet zwischen echt und gefälscht.

Durch einen iterativen Prozess versucht der Generator, Daten zu erzeugen, die zunehmend nicht mehr von authentischen Inhalten zu unterscheiden sind, während der Diskriminator immer geschickter darin wird, Fälschungen zu identifizieren. Diese kontroverse Trainingsschleife führt zur Erstellung äußerst realistischer Deepfakes.

Fortschritte in der KI

Jüngste Fortschritte in der KI-Technologie haben die Zugänglichkeit und den Realismus der Deepfake-Erstellung erheblich verbessert.

- Verbesserte Algorithmen: Forscher verfeinern kontinuierlich Deep-Learning-Algorithmen, um sie effizienter und effektiver bei der Generierung hochwertiger synthetischer Medien zu machen.

- Erhöhte Rechenleistung: Die Verfügbarkeit leistungsstarker Rechenressourcen ermöglicht ein schnelleres Training und eine Ausgabe mit höherer Auflösung und trägt so zu überzeugenderen Deepfakes bei.

- Zugängliche Tools und Plattformen: Open-Source-Bibliotheken und benutzerfreundliche Software haben die Erstellung von Deepfakes für Personen mit begrenztem technischen Fachwissen zugänglicher gemacht und den Prozess demokratisiert.

- Transferlernen und vorab trainierte Modelle: Vorab trainierte Modelle und Transferlerntechniken ermöglichen es Benutzern, vorhandenes Wissen und Daten zu nutzen und so den Aufwand für die Erstellung überzeugender Deepfakes zu reduzieren.

- Ethische und regulatorische Herausforderungen: Da sich die KI-Fähigkeiten weiterentwickeln, besteht ein wachsender Bedarf an ethischen Richtlinien und regulatorischen Rahmenbedingungen, um dem potenziellen Missbrauch der Deepfake-Technologie entgegenzuwirken und ihre schädlichen Auswirkungen auf die Gesellschaft abzumildern.

Da sich die Deepfake-Technologie ständig weiterentwickelt, wird die Bedeutung der KI-Regulierung im Kampf gegen Fehlinformationen immer deutlicher. Eine wirksame Regulierung kann einen Rahmen für die Entwicklung und den Einsatz von KI-Algorithmen bieten, einschließlich solcher, die zur Erstellung und Erkennung von Deepfakes verwendet werden. Durch die Umsetzung von Richtlinien, die Transparenz, Rechenschaftspflicht und ethischen Einsatz von KI-Technologie fördern, können Regulierungsbehörden dazu beitragen, die schädlichen Auswirkungen von Deepfake-Manipulationen auf die Gesellschaft abzumildern. Durch die Zusammenarbeit zwischen politischen Entscheidungsträgern, Branchenakteuren und Technologieexperten können wir Richtlinien festlegen, die die Integrität digitaler Inhalte schützen und das Vertrauen in die Medien wahren. Das Verständnis der Rolle der KI-Regulierung ist für unsere laufenden Bemühungen, die Bedrohungen durch KI-gesteuerte Fehlinformationen zu erkennen und zu bekämpfen, von entscheidender Bedeutung.

Arten von Deepfakes

Video- und Audio-Deepfakes

- Video-Deepfakes: Bei Video-Deepfakes werden visuelle Inhalte manipuliert, um den Eindruck zu erwecken, als würde jemand etwas sagen oder tun, was er nicht getan hat. Beispielsweise könnte ein Video-Deepfake das Gesicht einer Person in einem Videoclip mit dem Körper einer anderen Person überlagern und so den Eindruck erwecken, als würde sie Handlungen ausführen oder Worte sprechen, die sie nie getan hätte. Ein bemerkenswertes Beispiel für Video-Deepfakes ist die Technologie, mit der die Gesichter von Schauspielern in Filmen oder Fernsehsendungen digital ersetzt werden, sodass Filmemacher Szenen mit verstorbenen Schauspielern nachstellen oder Darbietungen während der Postproduktion modifizieren können.

- Audio-Deepfakes: Audio-Deepfakes verändern oder erstellen Audioaufnahmen, um den Eindruck zu erwecken, als würde jemand etwas sagen, was er nie getan hat. Dabei kann es sich um die Synthetisierung von Sprache handeln, um die Stimme einer bestimmten Person nachzuahmen, oder um die Änderung bestehender Aufnahmen, um die gesprochenen Wörter zu ändern. Audio-Deepfakes könnten beispielsweise verwendet werden, um Aufnahmen von Persönlichkeiten des öffentlichen Lebens zu fabrizieren, die hetzerische Äußerungen abgeben, oder um die Stimme einer anderen Person für betrügerische Zwecke nachzuahmen, beispielsweise um sich bei einem Telefonanruf als CEO auszugeben, um Finanztransaktionen zu genehmigen.

Deepfake-Anwendungen

- Unterhaltung: Deepfake-Technologie kann in der Unterhaltungsbranche eingesetzt werden, um ansprechende und innovative Inhalte zu erstellen, etwa um verstorbene Schauspieler für neue Auftritte digital wiederzubeleben oder Schauspieler nahtlos in Szenen zu integrieren, in denen sie ursprünglich nicht anwesend waren.

- Visuelle Effekte: Deepfakes können den Prozess der Erstellung visueller Effekte für Filme, Fernsehsendungen und Videospiele rationalisieren, Produktionskosten und -zeit reduzieren und gleichzeitig den Realismus verbessern.

Bildung und Forschung: Forscher können Deepfake-Technologie für akademische Zwecke nutzen, beispielsweise zur Untersuchung der menschlichen Wahrnehmung oder zur Erforschung der möglichen Anwendungen von KI in verschiedenen Bereichen.

Schädliche Verwendung:

- Fehlinformationen: Deepfakes können als Waffe eingesetzt werden, um falsche Informationen oder Propaganda zu verbreiten, die öffentliche Meinung zu manipulieren und das Vertrauen in Medien und Institutionen zu untergraben. Deepfake-Videos könnten beispielsweise verwendet werden, um Aufnahmen von politischen Persönlichkeiten zu fabrizieren, die kontroverse Aussagen machen, oder um irreführende Nachrichtenberichte zu erstellen.

- Betrug: Kriminelle können Deepfake-Technologie für betrügerische Zwecke nutzen, etwa um sich in Audio- oder Videoaufzeichnungen als Personen auszugeben, um andere aus finanziellen Gründen zu täuschen. Dies könnte die Erstellung gefälschter Audioaufnahmen von Bankmanagern umfassen, die betrügerische Transaktionen genehmigen, oder die Erstellung von Video-Testimonials, in denen betrügerische Produkte oder Dienstleistungen befürwortet werden.

- Reputationsschaden: Deepfakes können den Ruf von Einzelpersonen schädigen, indem sie sie bei unangemessenen oder illegalen Aktivitäten darstellen. Beispielsweise könnte Deepfake-Pornografie dadurch entstehen, dass die Gesichter von Personen ohne deren Zustimmung expliziten Inhalten überlagert werden, was zu emotionalem Stress und Rufschädigung führen könnte.

Auswirkungen von Deepfakes

Über Politik und Wahlen

- Einfluss auf die öffentliche Meinung: Deepfakes haben das Potenzial, die öffentliche Meinung erheblich zu beeinflussen, indem sie falsche Informationen verbreiten und die Wahrnehmung politischer Persönlichkeiten manipulieren. Deepfake-Videos könnten beispielsweise verwendet werden, um Politiker zu zeigen, die unethisches oder illegales Verhalten an den Tag legen, die Meinung der Wähler beeinflussen und das Vertrauen in demokratische Institutionen untergraben.

- Eingriff in den demokratischen Prozess: Deepfakes stellen eine ernsthafte Bedrohung für die Integrität von Wahlen dar, da sie es böswilligen Akteuren ermöglichen, den politischen Diskurs zu manipulieren und den demokratischen Prozess zu untergraben. Beispielsweise könnten Deepfake-Videos verwendet werden, um Reden oder Aussagen von Kandidaten zu fabrizieren, was bei Wählern Verwirrung und Misstrauen hervorrufen und möglicherweise den Wahlausgang beeinflussen könnte.

Über Gesellschaft und Individuen

- Auswirkungen auf den persönlichen Ruf: Deepfakes können verheerende Folgen für den persönlichen Ruf von Personen haben, indem sie sie in kompromittierenden oder peinlichen Situationen darstellen. Beispielsweise könnte Deepfake-Pornografie von böswilligen Akteuren erstellt werden, was zu Reputationsschäden und emotionalem Stress für die abgebildeten Personen führen könnte.

- Datenschutzbedenken: Deepfakes werfen erhebliche Datenschutzbedenken auf, da sie dazu verwendet werden können, ohne deren Zustimmung äußerst überzeugende Fälschungen von Gesichtern und Stimmen einzelner Personen zu erstellen. Dieser Eingriff in die Privatsphäre untergräbt nicht nur die Autonomie des Einzelnen über sein eigenes Bild und seine eigene Stimme, sondern birgt auch die Gefahr von Identitätsdiebstahl und Identitätsdiebstahl.

- Verbreitung von Fehlinformationen: Die weit verbreitete Verbreitung von Deepfakes trägt zur Verbreitung von Fehlinformationen bei und macht es für Einzelpersonen immer schwieriger, Wahrheit von Unwahrheit zu unterscheiden. Dieser Vertrauensverlust in Medien und Informationsquellen kann weitreichende Folgen für die Gesellschaft haben, einschließlich einer verstärkten sozialen Spaltung und Polarisierung.

Rechtliche und ethische Bedenken

- Rechtliche Konsequenzen: Die Erstellung und Verbreitung von Deepfakes wirft komplexe rechtliche Fragen auf, darunter Bedenken im Zusammenhang mit Verleumdung, Verletzung von geistigem Eigentum und Datenschutzverletzungen. Die aktuellen Gesetze gehen möglicherweise nicht ausreichend auf die besonderen Herausforderungen ein, die die Deepfake-Technologie mit sich bringt, was die Notwendigkeit aktualisierter Gesetze und regulatorischer Rahmenbedingungen zur Bewältigung dieser Probleme unterstreicht.

- Ethische Dilemmata: Die ethischen Implikationen der Deepfake-Technologie sind tiefgreifend, da sie die Grenze zwischen Realität und Fiktion verwischt, Fragen der Einwilligung und Autonomie aufwirft und das Vertrauen in visuelle und akustische Beweise untergräbt. Ethische Überlegungen zum verantwortungsvollen Einsatz von Deepfake-Technologie und zum Schutz der Rechte des Einzelnen müssen sowohl von den Urhebern als auch von den politischen Entscheidungsträgern sorgfältig abgewogen werden.

Deepfakes erkennen

Technische Indikatoren

- Unnatürliches Blinzeln: Deepfake-Videos können unnatürliche Blinzelmuster oder Unregelmäßigkeiten in den Augenbewegungen aufweisen, da die KI möglicherweise Schwierigkeiten hat, das natürliche Augenverhalten genau nachzubilden.

Schlechte Lippensynchronisation: In vielen Fällen können in Deepfake-Videos Lippenbewegungen vorkommen, die nicht mit dem Ton übereinstimmen, was zu merklichen Diskrepanzen zwischen den gesprochenen Worten und den Lippenbewegungen führt. - Inkonsistente Beleuchtung: Deepfake-Videos haben oft Schwierigkeiten, eine gleichmäßige Beleuchtung über die manipulierten und ursprünglichen Elemente hinweg aufrechtzuerhalten, was zu inkonsistenten Beleuchtungen führt, die auf Manipulationen hinweisen können.

Erkennungstools und -techniken

- KI-basierte Tools: Es wurden verschiedene KI-basierte Tools und Software entwickelt, um Deepfake-Inhalte durch die Analyse subtiler Inkonsistenzen und Artefakte in Videos und Audioaufnahmen zu erkennen. Diese Tools nutzen Algorithmen des maschinellen Lernens, um Muster zu identifizieren, die auf eine Deepfake-Manipulation hinweisen, wie etwa Diskrepanzen bei Gesichtsbewegungen oder Inkonsistenzen bei Details auf Pixelebene.

- Forensische Analyse: Forensische Techniken wie die Analyse von Metadaten, die Untersuchung von Komprimierungsartefakten und die Durchführung einer Analyse auf Pixelebene können ebenfalls eingesetzt werden, um Anzeichen einer Deepfake-Manipulation zu erkennen. Durch die Untersuchung der zugrunde liegenden technischen Merkmale digitaler Medien können Forensiker Spuren von Manipulationen aufdecken, die mit bloßem Auge möglicherweise nicht sofort erkennbar sind.

Herausforderungen bei der Erkennung

- Wettrüsten zwischen Erstellung und Erkennung: Die rasante Weiterentwicklung der Deepfake-Erstellungstechniken stellt eine erhebliche Herausforderung für die Erkennungsbemühungen dar, da sich ständig neue Algorithmen und Methoden weiterentwickeln, um überzeugendere Fälschungen zu erzeugen. Dieses anhaltende Wettrüsten zwischen Deepfake-Erstellung und Erkennungstechnologien unterstreicht die Notwendigkeit kontinuierlicher Innovation und Anpassung seitens der Erkennungstools und -techniken.

- Mit den KI-Fortschritten Schritt halten: Da sich die KI-Technologien ständig weiterentwickeln, müssen Erkennungsmethoden mit diesen Fortschritten Schritt halten, um Deepfake-Inhalte effektiv zu identifizieren. Dies erfordert jedoch erhebliche Ressourcen und Fachwissen, da sich Erkennungsalgorithmen ständig an neue Techniken und Strategien anpassen müssen, die von Deepfake-Erstellern eingesetzt werden.

- Komplexität des Inhalts: Die Erkennung von Deepfakes wird immer schwieriger, da die Komplexität manipulierter Inhalte zunimmt. Deepfake-Videos, die ausgefeilte Bearbeitungstechniken beinhalten oder hochwertiges Quellmaterial verwenden, können beispielsweise schwieriger zu erkennen sein als einfachere Fälschungen. Daher müssen Erkennungstools in der Lage sein, eine Vielzahl von Medienformaten und Inhaltstypen zu analysieren, um Deepfakes effektiv zu identifizieren.

Bekämpfung von Deepfake-Fehlinformationen

Öffentliches Bewusstsein und Bildung

- Kritische Denkfähigkeiten: Die Aufklärung der Öffentlichkeit über das Erkennen und skeptische Bewerten von Medieninhalten ist für die Bekämpfung der Verbreitung von Deepfakes von entscheidender Bedeutung. Indem wir kritische Denkfähigkeiten fördern und Einzelpersonen ermutigen, die Authentizität digitaler Medien in Frage zu stellen, können wir Menschen in die Lage versetzen, potenzielle Fehlinformationen und irreführende Inhalte zu erkennen.

- Programme zur Medienkompetenz: Die Implementierung von Programmen zur Medienkompetenz in Schulen und Gemeinden kann Einzelpersonen dabei helfen, die Fähigkeiten zu entwickeln, die sie benötigen, um sich effektiv in der digitalen Landschaft zurechtzufinden. Diese Programme können Einzelpersonen beibringen, Quellen zu überprüfen, die Glaubwürdigkeit von Informationen zu bewerten und häufige Anzeichen von Manipulation in Medieninhalten zu erkennen.

Politik und Regulierung

- Kriminalisierung bösartiger Deepfakes: Die Einführung von Gesetzen, die die Erstellung und Verbreitung bösartiger Deepfakes unter Strafe stellen, kann als Abschreckung gegen deren Verwendung für schädliche Zwecke dienen. Zu den rechtlichen Rahmenbedingungen können Strafen für Personen gehören, die für schuldig befunden werden, Deepfakes mit der Absicht erstellt oder verbreitet zu haben, andere zu täuschen oder zu schädigen.

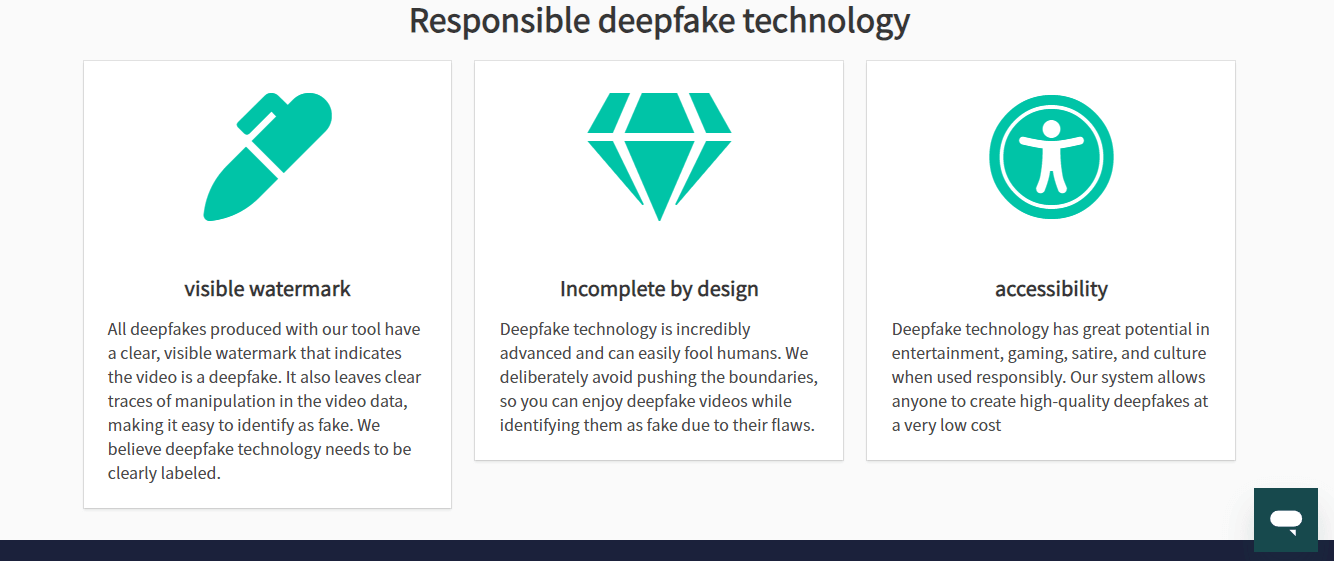

- Regulierung der Deepfake-Technologie: Regierungen könnten erwägen, die Entwicklung und Verbreitung der Deepfake-Technologie zu regulieren, um deren Missbrauch zu verhindern. Dazu können Lizenzanforderungen für Entwickler, Beschränkungen des Zugriffs auf bestimmte Algorithmen oder Datensätze sowie Aufsichtsmechanismen gehören, um die Einhaltung ethischer Standards und Richtlinien sicherzustellen.

Rolle von Technologieunternehmen

- Entwicklung von Erkennungstools: Social-Media-Plattformen und Technologieunternehmen können in die Entwicklung fortschrittlicher Erkennungstools und Algorithmen investieren, um die Verbreitung von Deepfake-Inhalten auf ihren Plattformen zu erkennen und einzudämmen. Durch den Einsatz von KI und maschinellem Lernen können diese Unternehmen Deepfakes effektiver erkennen und entfernen und so Benutzer vor schädlichen Fehlinformationen schützen.

- Förderung der Medienkompetenz: Technologieunternehmen können auch eine Rolle bei der Förderung der Medienkompetenz und der digitalen Bürgerschaft ihrer Nutzer spielen. Dies kann die Bereitstellung von Bildungsressourcen, Tools und Tutorials zur Erkennung von Deepfakes und zur Überprüfung der Authentizität digitaler Medien umfassen.

- Zusammenarbeit mit Experten: Die Zusammenarbeit mit akademischen Forschern, forensischen Experten und anderen Interessengruppen kann die Fähigkeiten von Technologieunternehmen bei der Erkennung und Bekämpfung von Deepfakes verbessern. Durch die Zusammenarbeit können diese Unternehmen Wissen, Ressourcen und Best Practices austauschen, um robustere Strategien zur Bewältigung der Herausforderungen zu entwickeln, die die Deepfake-Technologie mit sich bringt.

Zukunft von Deepfakes

Während Deepfake-Technologie in erster Linie mit negativen Auswirkungen verbunden ist, gibt es auch potenzielle positive Einsatzmöglichkeiten in verschiedenen Bereichen. Im Unterhaltungsbereich könnten Deepfakes das Filmemachen revolutionieren, indem sie nahtlose digitale Nachbildungen von Schauspielern ermöglichen, ikonische Charaktere wieder zum Leben erwecken oder behinderten Schauspielern Zugänglichkeit bieten. Im Bildungsbereich könnten Deepfakes immersive Lernerfahrungen ermöglichen, historische Persönlichkeiten zum Leben erwecken oder realistische Szenarien für Schulungszwecke simulieren. Darüber hinaus versprechen Deepfakes die Bewahrung und Aufwertung historischer Archive und ermöglichen künftigen Generationen die Interaktion mit historischen Persönlichkeiten oder Ereignissen auf beispiellose Weise. Dennoch bestehen in der Deepfakes-Landschaft weiterhin Risiken und Herausforderungen, da die Fortschritte bei der KI-gesteuerten Manipulation weiterhin die Erkennungsbemühungen übertreffen. Die Verbreitung KI-generierter Fehlinformationen stellt eine erhebliche Bedrohung für das gesellschaftliche Vertrauen dar und erfordert kontinuierliche Wachsamkeit, technologische Innovation und regulatorische Maßnahmen, um ihre schädlichen Auswirkungen abzumildern und die Integrität digitaler Inhalte zu schützen.

Bei der Bekämpfung KI-gesteuerter Fehlinformationen spielt das Fachwissen von SEO-Experten eine entscheidende Rolle bei der Sensibilisierung und Verbreitung wertvoller Erkenntnisse über Strategien zur Erkennung und Eindämmung von Deepfakes. SEO-Experten verfügen über die Fähigkeiten, Online-Inhalte zu optimieren und ihre Sichtbarkeit für ein breites Publikum sicherzustellen, was sie zu unschätzbaren Verbündeten bei der Verbreitung von Wissen über die Identifizierung und Bekämpfung von Deepfake-Bedrohungen macht. Durch die Nutzung ihrer Kenntnisse in digitalen Marketingtechniken und der Verbreitung von Inhalten können SEO-Experten die Reichweite von Bildungsressourcen und Sensibilisierungskampagnen mit Schwerpunkt auf Deepfake-Bewusstsein erhöhen. Durch die Zusammenarbeit zwischen SEO-Experten, Content-Erstellern und Technologieexperten können wir Einzelpersonen und Organisationen in die Lage versetzen, sich in der Komplexität der digitalen Landschaft zurechtzufinden und uns vor der Verbreitung KI-gesteuerter Fehlinformationen zu schützen.

Mit ChatGPT Schweiz durch die Deepfake-Landschaft navigieren

Im heutigen digitalen Zeitalter stellt die Verbreitung der Deepfake-Technologie beispiellose Herausforderungen bei der Unterscheidung zwischen Wahrheit und Fiktion dar. ChatGPT Schweiz steht an vorderster Front im Kampf gegen KI-gesteuerte Fehlinformationen und bietet wertvolle Erkenntnisse und Tools, um sich effektiv in der Deepfake-Landschaft zurechtzufinden. Angesichts der Zunahme von Deepfake-Inhalten, die die Integrität des Online-Diskurses gefährden, ist es wichtiger denn je zu verstehen, wie diese betrügerischen Praktiken erkannt und bekämpft werden können. Durch Bildung, Zusammenarbeit und technologische Innovation können wir Einzelpersonen und Organisationen in die Lage versetzen, die Verbreitung von Fehlinformationen zu bekämpfen und die Integrität digitaler Medien zu wahren.

Abschluss

Im digitalen Zeitalter kann die Bedeutung des Verstehens, Erkennens und Bekämpfens von Deepfakes für die Wahrung von Wahrheit und Integrität gar nicht genug betont werden. Deepfakes drohen das Vertrauen in die Medien zu untergraben, die öffentliche Meinung zu manipulieren und demokratische Prozesse zu untergraben, was die dringende Notwendigkeit kollektiven Handelns verdeutlicht. Einzelpersonen müssen Fähigkeiten zum kritischen Denken und Medienkompetenz entwickeln, um authentische Inhalte von manipuliertem Material zu unterscheiden. Technologieunternehmen müssen in die Entwicklung robuster Erkennungstools und Algorithmen investieren, um die Verbreitung von Deepfakes auf ihren Plattformen einzudämmen. Regierungen müssen umfassende rechtliche Rahmenbedingungen und Vorschriften erlassen, um den böswilligen Einsatz von Deepfake-Technologie zu verhindern und die Täter zur Rechenschaft zu ziehen. Nur durch gemeinsame Anstrengungen aller Beteiligten können wir den Herausforderungen durch Deepfakes wirksam begegnen und die Grundprinzipien von Wahrheit und Integrität in der digitalen Landschaft wahren.

FAQs

1. Auf welche Weise können Deepfakes potenziell missbraucht werden?

Deepfakes können auf verschiedene Weise missbraucht werden und eine erhebliche Bedrohung für Einzelpersonen, Organisationen und die Gesellschaft insgesamt darstellen. Ein häufiger Missbrauch von Deepfakes ist die Verbreitung von Fehlinformationen, bei denen gefälschte Videos oder Audioaufnahmen verbreitet werden, um die öffentliche Meinung zu manipulieren oder das Publikum zu täuschen. Politische Persönlichkeiten, Prominente und gewöhnliche Einzelpersonen können gleichermaßen zum Ziel von Deepfake-Manipulationen werden und dadurch ihrem Ruf oder ihrem Privat- und Berufsleben schaden.

2. Wie kann KI im Kampf gegen Deepfakes helfen?

Künstliche Intelligenz (KI) spielt eine entscheidende Rolle im Kampf gegen Deepfakes, indem sie die Entwicklung fortschrittlicher Erkennungstools und -techniken ermöglicht. KI-Algorithmen können große Mengen digitaler Mediendaten analysieren, um Muster und Anomalien zu identifizieren, die auf Deepfake-Manipulation hinweisen. Modelle für maschinelles Lernen können auf verschiedenen Datensätzen trainiert werden, die sowohl authentische als auch manipulierte Inhalte enthalten, sodass sie subtile Hinweise und Artefakte erkennen können, die mit der Erstellung von Deepfakes verbunden sind.

3. Was ist für die Deepfake-Erkennung erforderlich?

Die Notwendigkeit der Deepfake-Erkennung ist von größter Bedeutung, um die Integrität digitaler Inhalte zu schützen und das Vertrauen in visuelle und akustische Medien zu wahren. Da die Deepfake-Technologie immer weiter voranschreitet und immer zugänglicher wird, wächst das Potenzial für ihren böswilligen Missbrauch exponentiell. Ohne wirksame Erkennungsmechanismen sind Einzelpersonen und Organisationen anfällig für die schädlichen Auswirkungen von Deepfake-Manipulationen, darunter Reputationsschäden, finanzielle Verluste und soziale Unruhen. Erkennungstools und -techniken sind unerlässlich, um die Verbreitung von Deepfake-Inhalten auf verschiedenen Online-Plattformen zu erkennen und einzudämmen und sicherzustellen, dass Benutzer sicher zwischen authentischen und manipulierten Medien unterscheiden können.

4. Was ist Deepfake und welche Auswirkungen hat es auf die Gesellschaft?

Deepfake-Technologie hat tiefgreifende Auswirkungen auf die Gesellschaft und wirkt sich auf verschiedene Aspekte des öffentlichen Diskurses, der Privatsphäre und demokratischer Prozesse aus. Die weitverbreitete Verbreitung von Deepfakes untergräbt das Vertrauen in traditionelle Medienquellen und stellt die Authentizität visueller und akustischer Informationen in Frage. Indem sie die Grenze zwischen Realität und Fiktion verwischen, verschärfen Deepfakes die gesellschaftliche Polarisierung und tragen zum Vertrauensverlust in Institutionen und Persönlichkeiten des öffentlichen Lebens bei.